Tvorca ChatGPT má problém – vraj používa nezákonné dohody o mlčanlivosti

Spoločnosť OpenAI, ktorá stojí za chatbotom umelej inteligencie ChatGPT, čelí novým obvineniam. Jej dohody o mlčanlivosti so zamestnancami vraj prekračujú zákonné medze a bránia zamestnancom oznamovať úradom prípadnú nekalú činnosť.

Spoločnosť OpenAI čelí novým obvineniam od anonymných oznamovateľov nekalej činnosti – tzv. whistleblowerov, že firma používa nelegálne, príliš reštriktívne dohody o mlčanlivosti (tzv. NDA).

OpenAI continues to be the worst.

It's like they have a weekly quota to meet for PR blunders.https://t.co/w6n9HoTtIt pic.twitter.com/mfYbutqUHx

— Reid Southen (@Rahll) July 14, 2024

Tieto dohody údajne výrazne obmedzujú možnosti zamestnancov oznamovať úradom nezákonné alebo neetické praktiky tejto spoločnosti. Uviedli to vo svojom liste predsedovi SEC Garymu Genslerovi právnici zastupujúci dotknutých oznamovateľov.

Dohody o mlčanlivosti sú vraj formulované tak, že ak by súčasný alebo aj bývalý zamestnanec spoločnosti, ba dokonca aj investor chcel štátnym orgánom niečo oznámiť, musí na to najprv získať súhlas spoločnosti. Táto správa prináša ďalšie otázky o transparentnosti a etických praktikách jednej z popredných spoločností v oblasti umelej inteligencie.

Právne dôsledky a reakcie

Toto obvinenie môže pre spoločnosť OpenAI znamenať aj právne dôsledky. Právni experti sa domnievajú, že takéto reštriktívne dohody by mohli byť v rozpore s federálnymi zákonmi o ochrane oznamovateľov v USA. Okrem toho spoločnosť čelí aj zvýšenému verejnému tlaku na posilnenie transparentnosti a dodržiavanie etických štandardov.

Dohody o mlčanlivosti sú bežnou praxou v mnohých technologických aj iných firmách, ktoré chránia svoje obchodné tajomstvá a interné procesy. V prípade OpenAI však tieto dohody údajne prekračujú bežné hranice a obmedzujú slobodu prejavu a oznamovateľské práva zamestnancov.

Budúcnosť OpenAI a etické výzvy

Tento incident poukazuje na širšie etické výzvy, ktorým čelí priemysel umelej inteligencie. OpenAI ako líder v oblasti AI musí čeliť otázkam o tom, ako vyvážiť ochranu svojich technologických tajomstiev s potrebou byť transparentnou a eticky zodpovednou firmou. Z firmy pritom v nedávnych mesiacoch odišlo viacero významných zamestnancov.

Medzi nimi odišiel z OpenAJ aj jej spoluzakladateľ tejto firmy Ilya Sutskever, ktorý následne 19. júna oznámil založenie konkurenčnej firmy SSI (SuperIntelligence Inc.), ktorej primárnym cieľom má byť pri vývoji AI dbanie na bezpečnosť.

Superintelligence is within reach.

Building safe superintelligence (SSI) is the most important technical problem of our time.

We've started the world’s first straight-shot SSI lab, with one goal and one product: a safe superintelligence.

It’s called Safe Superintelligence…

— SSI Inc. (@ssi) June 19, 2024

Viacerí bývalí zamestnanci OpenAI svoj odchod odôvodnili obavami, že spoločnosť sa nebude v súvislosti s možnosťami umelej inteligencie správať dostatočne zodpovedne.

Otázky ohľadom dohôd o mlčanlivosti v OpenAI sú len jednou z mnohých etických dilem, ktoré spoločnosti v oblasti AI musia riešiť. Pre ďalší vývoj tohto prípadu bude dôležité, ako bude OpenAI reagovať na tieto výzvy a aké kroky podnikne na zabezpečenie spravodlivého a transparentného pracovného prostredia.

Ďalšie zaujímavosti z OpenAI

Okrem týchto negatívnych správ nás v súvislosti s OpenAI zaujali aj tieto novinky:

- firma pracuje na projekte Strawberry, ktorý by mohol byť nástupcom ChatGPT. Strawberry by mal vedieť sám uvažovať a vopred plánovať

- OpenAI menovala 5 fáz vývoja umelej inteligencie – sme pravdepodobne medzi prvou a druhou fázou

Zdroj: TechCrunch

Najčítanejšie články

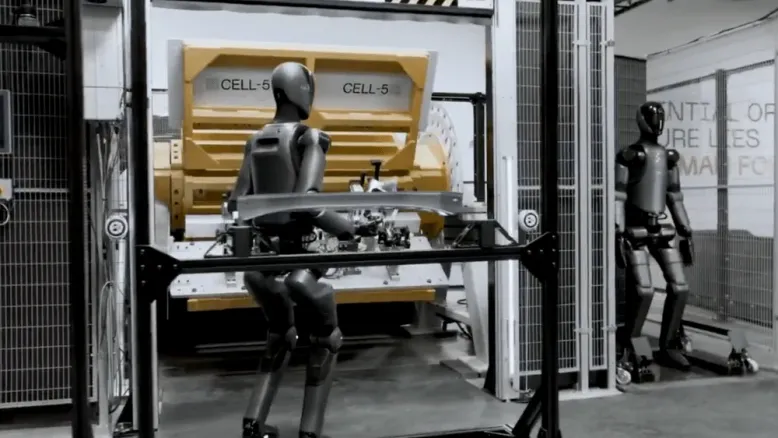

VIDEO: Humanoidy Figure 02 začali pracovať vo fabrike BMW

21. novembra 2024

SpaceX uskutočnila šiesty let rakety Starship - tentokrát nedopadol podľa predstáv

21. novembra 2024

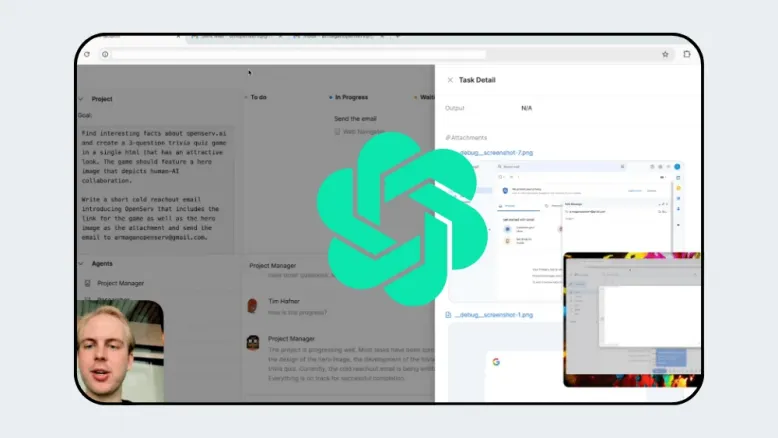

OpenAI chystá revolučného AI agenta na ovládanie počítača

20. novembra 2024

Meta AI dorazila do prvých európskych krajín – v okuliaroch Ray-Ban Meta

20. novembra 2024